Задумывались ли вы, насколько качество контента определяет успех онлайн-платформ? Исследования Microsoft показывают, что средняя продолжительность концентрации внимания человека составляет всего 8 секунд — меньше, чем у золотой рыбки. Любая задержка, ошибка или неподобающий контент, включая спам, мошеннические схемы или оскорбительные высказывания, могут мгновенно отпугнуть аудиторию.

За последний год 55% компаний сообщили об увеличении убытков, связанных с онлайн-мошенничеством из-за недостаточной модерации контента, пишет Experian. В Великобритании 62% молодых пользователей социальных сетей признались, что получали оскорбительные комментарии, многие из которых содержали ненависть на основе расы, сексуальной ориентации или гендерной идентичности, отмечает Universities U.K.

Цена недостаточного внимания к проблемам модерации огромна: помимо прямых финансовых потерь, платформы рискуют лишиться доверия аудитории. Согласно Bright Local, 76% потребителей доверяют отзывам так же, как советам друзей, но, столкнувшись с ложной информацией, они чаще всего покидают платформу навсегда.

Эти факты ясно показывают: быстрая, качественная и надежная модерация контента — это не опция, а обязательное условие выживания и роста для многих онлайн-бизнесов. Давайте разберемся, что какие виды модерации существуют, в чем заключается разница между ними и что лучше всего подходит под ваши задачи.

Где применяется модерация контента?

Если в двух словах, то модерация контента — это процесс проверки и контроля пользовательского контента на онлайн-платформах, чтобы убедиться, что он соответствует определённым стандартам и правилам. Она включает удаление неподобающего или оскорбительного контента и обеспечение соблюдения руководств сообщества и условий использования.

Практика модерации контента широко используется на платформах, которые в основном зависят от пользовательского контента. Давайте рассмотрим несколько примеров:

Социальные сети

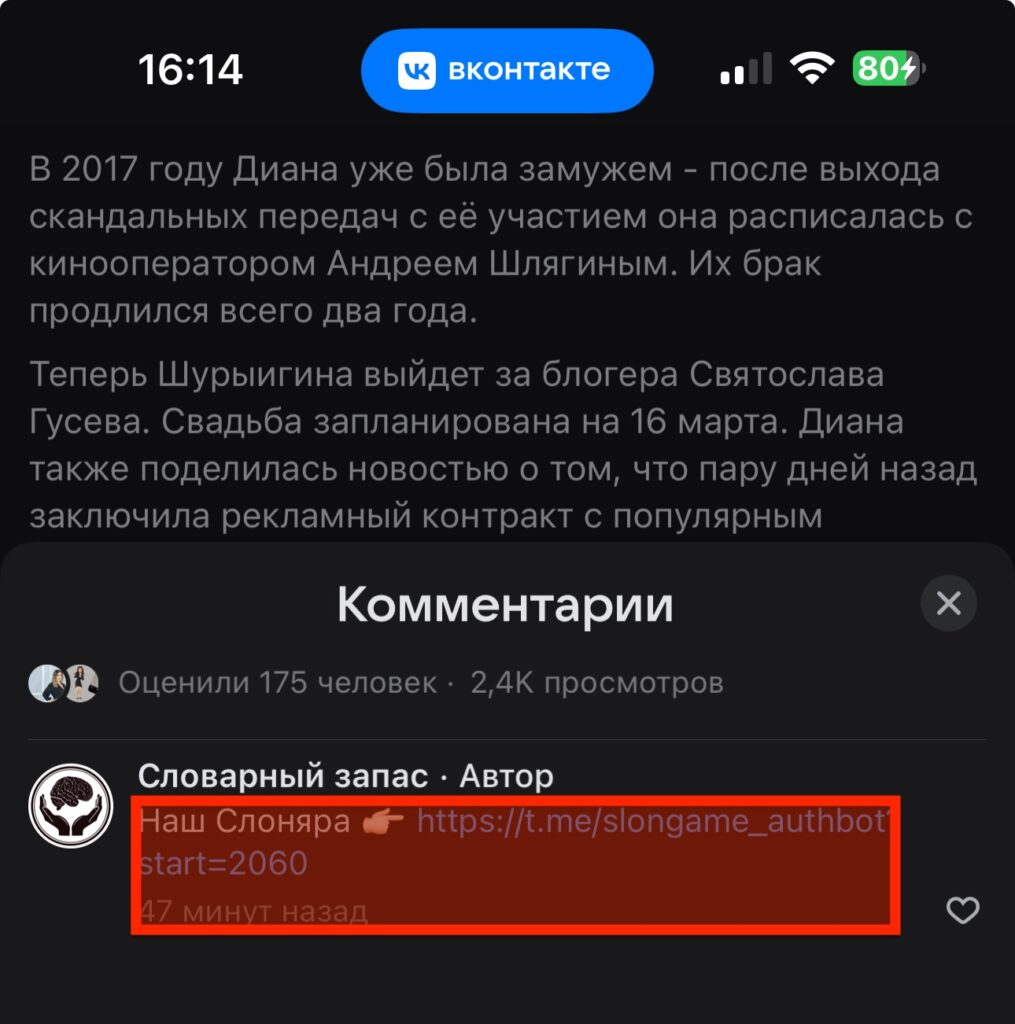

В социальных сетях ежедневно публикуются миллионы постов, комментариев, изображений и видео. Удаление нежелательного контента — спама, оскорблений, разжигания ненависти — попросту необходимо для сохранения здоровой атмосферы и удержания пользователей.

Представим ситуацию: известная соцсеть столкнулась с массовым появлением фейковых аккаунтов, продвигающих спамные ссылки. Именно использование гибридной модерации может помочь оперативно выявить нарушителей: модель определяет подозрительные аккаунты по схожим текстам сообщений, а модераторы вручную проверяют спорные случаи.

Маркетплейсы и онлайн-торговля

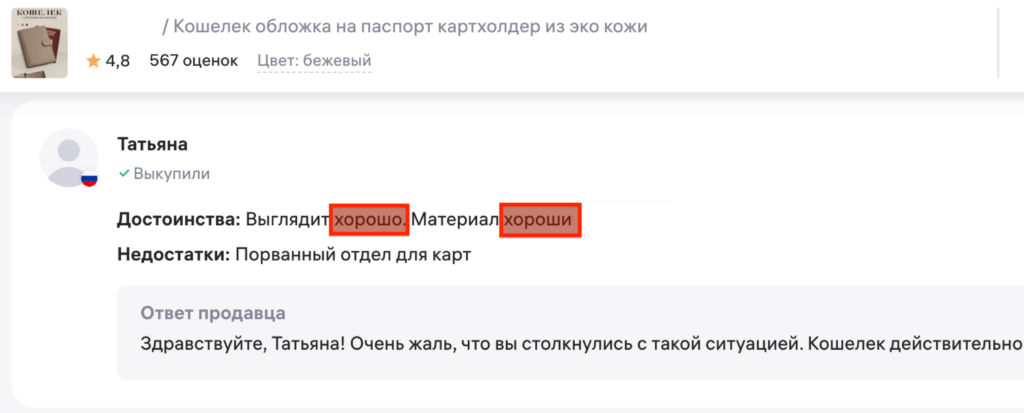

На крупных платформах вроде Amazon или Wildberries пользователи регулярно публикуют объявления и отзывы. Фейковые отзывы или объявления с нарушением правил могут подорвать доверие покупателей к площадке.

Именно поэтому один из крупнейших маркетплейсов внедрил систему модерации для борьбы с недостоверными отзывами. ИИ научили распознавать шаблонные комментарии и нестандартные способы обхода модерации. Например, злоумышленники добавляли символы, чтобы замаскировать текст. Модераторы дополнили работу модели, проверяя отзывы, которые система определила как «пограничные».

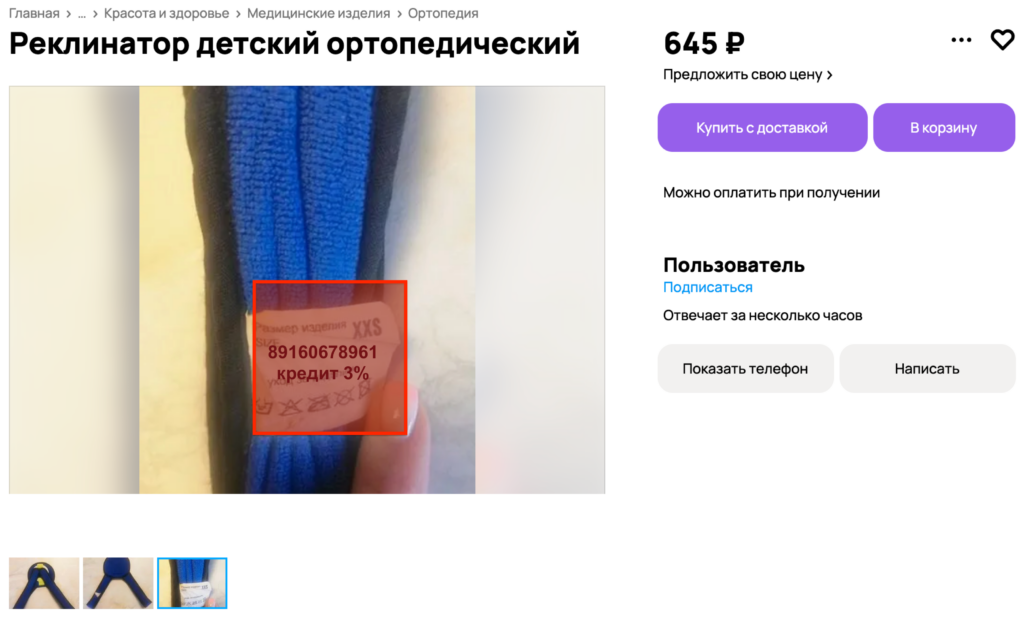

Платформы онлайн-объявлений

На сайтах с объявлениями пользователи часто пытаются разместить запрещённый контент — от рекламы сомнительных услуг до публикации контактной информации, обходящей правила платформы.

Для одного из таких сайтов наша команда разрабатывала систему модерации, которая распознавала телефонные номера на изображениях, скрытые в описаниях или спрятанные за графикой. Это позволило заказчику сократить ручную проверку объявлений и повысить соблюдение правил площадки.

Онлайн-игры

Чат в играх — это ключевой элемент взаимодействия между пользователями, но, к сожалению, он также может стать источником токсичного поведения, мошенничества или нецензурной лексики.

Приведем пример: в нескольких популярных многопользовательских играх был внедрен фильтр для распознавания оскорблений и угроз в чатах. Однако игроки начали обходить систему, используя звёздочки или заменяя буквы в словах. После внедрения гибридной модерации токсичные сообщения сократились.

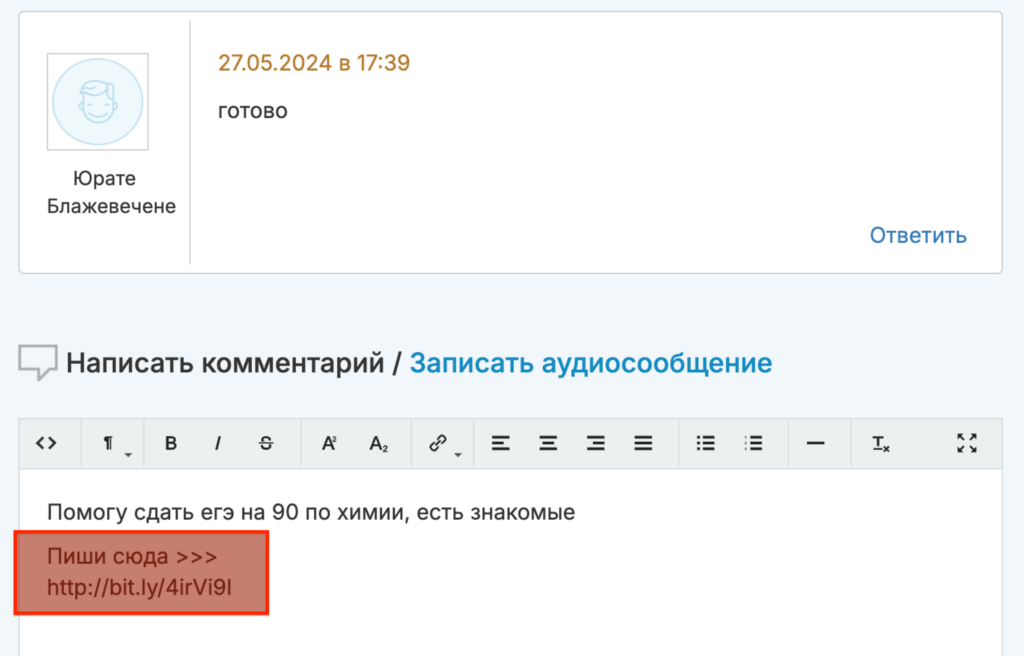

Образовательные платформы и форумы

На образовательных платформах модерация предотвращает распространение недостоверной информации и токсичного контента. К примеру, на одном портале для подготовки к экзаменам были выявлены пользователи, публиковавшие спам-ответы и ссылки на мошеннические ресурсы.

Автоматическая модерация помогла в блокировке подобных сообщений, а модераторы проверяли сложные случаи, например, вопросы с двусмысленным содержанием. Это позволило увеличить долю полезных комментариев на платформе на 30%.

Сайты знакомств

Сайты знакомств часто сталкиваются с мошенниками, спамерами и неподобающим контентом. Удаление таких аккаунтов и сообщений помогает сохранить доверие пользователей.

Одна крупная платформа для знакомств внедрила систему модерации, которая распознавала признаки спамных сообщений, например, ссылки на сторонние сайты или слишком шаблонные фразы. Наши модераторы вручную проверяли сообщения, отмеченные как потенциально подозрительные. Это позволило за три месяца сократить количество жалоб на спам на 40%.

Медиа и новостные платформы

Комментарии под статьями в новостных изданиях часто становятся основной целью троллей, которые пишут оскорбления и фейковую информацию. Именно поэтому большинство новостных порталов сейчас используют ИИ для фильтрации комментариев с нецензурными выражения и разжигание ненависти, а спорные случаи передаются модераторам. Для одного из наших клиентов это заметно улучшило пользовательский опыт: количество жалоб сократилось на 15% за полгода.

Как создать эффективные правила модерации контента?

Правильная модерация начинается с правильно прописанных правил, это возможность задать нужную атмосферу в сообществе. Вот как сделать это грамотно:

Задайте тон с помощью правил сообщества

Представьте, что вы пришли на вечеринку, а вам никто не объяснил, что там принято делать. Неловко, правда? Правила сообщества нужны, чтобы все понимали, как себя вести. Четко объясните, какое поведение и какой контент допустимы, а что вы будете блокировать.

- Делайте их доступными: Разместите правила в заметных местах — внизу сайта, на странице регистрации или в шапке форума.

- Говорите на языке аудитории: Если у вас пользователи из разных стран, переведите правила на несколько языков.

- Не забывайте их обновлять: Пересматривайте правила время от времени, чтобы они соответствовали реалиям. То, что было актуально год назад, может устареть или стать непонятным сегодня.

Работайте с негативными отзывами

Есть соблазн удалить все негативные комментарии, но это может создать вам плохую репутацию. Вместо этого воспринимайте критику как возможность.

Отвечайте с заботой: Признавайте ошибки и предлагайте решения. Например, если кто-то пожаловался на бракованный товар, поблагодарите за обратную связь и помогите оформить возврат.

Будьте доброжелательны: Когда пользователи видят, что вы решаете проблемы открыто, они начинают вам доверять. Бренды, которые конструктивно работают с негативом, демонстрируют свою честность. Это вызывает уважение.

Установите четкие протоколы действий

Если правила нарушаются, важно, чтобы реакция была последовательной и понятной. Прозрачность помогает сохранить доверие.

Постепенные меры: В случае нарушений многие используют такой эффективный подход:

Первое нарушение: предупреждение.

Второе: временная блокировка, например, на неделю.

Третье: полный бан.

Серьезные нарушения: Укажите, какие действия потребуют жестких мер, например, обращение в правоохранительные органы или немедленную блокировку аккаунта.

Так, если пользователь публикует спам с оскорблениями, можно временно заморозить его аккаунт. Но если он размещает незаконный и опасный контент, передайте информацию соответствующим органам. Автоматизация может помочь отфильтровать менее важные моменты, но серьезные случаи должны проверяться вручную.

Поощряйте вклад в сообщество

Хвалите пользователей за хороший контент — это стимулирует их участвовать в жизни сообщества еще активнее. Можно использовать игровые элементы: Награждайте знаками отличия, например, «Лучший участник», «Самый полезный комментарий».

Это не только вдохновляет самых активных пользователей продолжать публиковать такие ответы, но и мотивирует остальных. Новичок, увидевший значок «Герой сообщества», может подумать: «Хочу тоже заслужить такой!»

Как проводится модерация?

Итак, вы установили четкие правила и определились с политикой в отношении «нарушителей». Но как выстроить систему модерации?

Существует несколько подходов к модерации контента, и они зависят от потребностей конкретной компании или платформы. Давайте обсудим основные методы:

1. Ручная модерация

Это процесс, когда модераторы вручную проверяют контент, опубликованный пользователями. Они следуют конкретным правилам и инструкциям платформы, чтобы удалять нежелательный, незаконный, оскорбительный контент, бороться с мошенничеством и домогательствами.

Когда приходится использовать ручную модерацию:

- Небольшой объём данных или ограниченные ресурсы для обучения модели

В проектах с малым объёмом контента обучение моделей может оказаться затратным или даже нецелесообразным. Здесь ручная проверка информации будет быстрее и эффективнее. - Начало нового проекта

На этапе запуска платформы автоматические системы ещё не обладают достаточной базой данных, чтобы адекватно справляться с модерацией. Ручной подход не только обеспечивает текущую проверку контента, но и помогает собирать данные для последующего обучения моделей. - Сложные или специализированные данные

Если контент содержит уникальные особенности или относится к узкоспециализированной области, автоматизация может столкнуться с трудностями. Например, сложные языковые конструкции, редкие термины или уникальные культурные контексты остаются вне зоны понимания алгоритмов. В таких случаях требуется участие опытных специалистов, способных правильно интерпретировать сложные материалы.

| Преимущества ручной модерации | Недостатки ручной модерации |

|---|---|

| Глубокое понимание контекста Люди могут анализировать тонкости и скрытые смыслы сообщений, включая иронию, сарказм и культурные особенности, которые недоступны ИИ. | Ограниченные возможности масштабирования Не получится так же быстро увеличить объем модерируемых данных, как это можно сделать при помощи алгоритма. |

| Обработка спорных случаев Человеческая модерация незаменима для решения ситуаций, которые не вписываются в заранее установленные правила или вызывают сомнения. | Высокая стоимость Ручная модерация требует значительных финансовых вложений, включая зарплаты, обучение и управление командой. |

| Гибкость в новых или нестандартных ситуациях Модераторы быстро адаптируются к новым способам обхода правил или неожиданным формам нарушения. | Человеческий фактор Ошибки, связанные с усталостью, невнимательностью или предвзятостью, могут снизить качество модерации. |

| Этичность и деликатность Люди могут принимать решения с учетом культурных и социальных норм, проявляя тактичность там, где ИИ может быть слишком строг или безучастен. | Длительный процесс принятия решений По сравнению с ИИ, который действует мгновенно, человеку нужно больше времени для анализа каждого отдельного случая. |

| Обратная связь для обучения ИИ Ручная модерация помогает собирать данные для улучшения работы автоматизированных систем, обучая их на реальных примерах. | Психологически тяжелая работа Модераторы нередко сталкиваются с шокирующим контентом, содержащим сцены жестокости, сексуального насилия или обнаженного тела. Такое воздействие может привести к серьёзным проблемам с психическим здоровьем. |

2. Автоматическая модерация

Итак, объём пользовательского контента ежегодно растет на 30%, ручная модерация становится всё менее применимой и требуется в определенных случаях, так что обычно за проверку контента отвечают алгоритмы. Они автоматически решают, можно ли публиковать контент, нужно ли его отклонить или отправить на дополнительную проверку модератору. Автоматическая модерация становится оптимальным выбором в следующих случаях:

- Большой объём однотипного контента

Если платформа ежедневно обрабатывает миллионы сообщений, комментариев или медиа, автоматические алгоритмы эффективно фильтруют их, особенно при строгих и однозначных правилах (например, удаление спама или флагирование запрещённых слов).

На маркетплейсах, таких как eBay или Amazon, автоматические системы проверяют описания товаров и заголовки на запрещённые товары, некорректные выражения или попытки обойти правила.

- Чёткие и предсказуемые правила

Когда критерии модерации не допускают неоднозначности, автоматические системы отлично справляются. Это включает фильтрацию по словарям запрещённых слов, поиск подозрительных URL-адресов или изображений с неподобающим содержанием.

Соцсети используют алгоритмы для удаления изображений с явным нарушением политики (например, жестокие сцены или фото обнажённого тела), используя базы данных с эталонными изображениями.

- Высокая скорость реакции необходима

На платформах, где задержка в модерации может нанести вред, автоматические системы обеспечивают мгновенное действие.

Онлайн-игры, такие как Fortnite, используют автоматическую модерацию чатов, чтобы мгновенно блокировать ненормативную лексику или оскорбительные выражения.

- Обработка спама и ботов

Идентификация спам-сообщений или подозрительного поведения, характерного для ботов, идеально подходит для автоматической модерации.

| Преимущества ИИ в модерации | Минусы автоматической модерации |

|---|---|

| Молниеносная обработка огромных объемов данных Искусственный интеллект способен анализировать миллионы сообщений, изображений и видео за секунды, что недостижимо для человека. | Необходимость обучения на больших объемах данных Чтобы система могла эффективно выявлять, скажем, токсичный контент, её нужно предварительно обучить на тысяче примеров правильных и неправильных решений.Кроме того, данные должны быть релевантными и обновляться: если ИИ обучен только на старых примерах, он может не справляться с новыми изощренными способами обхода правил. |

| Высокая точность при наличии чётких правил Когда ИИ обучен на данных с чётко заданными критериями, он работает почти безошибочно. Например, система, обученная выявлять ненормативную лексику, может моментально распознавать запретные слова даже в больших текстах. | Сложности в обработке контекста Искусственный интеллект плохо понимает тонкости человеческого общения. Он может ошибиться там, где требуется учитывать контекст. Например:Спамеры часто находят необычные способы обхода алгоритмов: пишут “под@рок!с” вместо “подарок” в рекламе, или используют эмодзи вместо букв.Для решения таких задач ИИ требуется дообучение. Но все-таки чаще всего помогает подключение человеческой модерации. |

| Легкая масштабируемость ИИ отлично адаптируется к росту контента. Например, если новая социальная сеть вдруг взлетит до сотен миллионов пользователей, система искусственного интеллекта сможет без проблем справляться с увеличением объёма данных. В отличие от модераторов-людей, которых пришлось бы нанимать сотнями, ИИ можно быстро донастроить для обработки возросшего потока данных. |

3. Гибридная модерация

Как мы поняли, современные технологии ИИ позволяют эффективно выявлять нецензурную лексику, спам и другие виды нежелательного контента. Например, в России существует чёткий перечень слов, считающихся нецензурными. На основе этого списка ИИ может быть обучен автоматически анализировать текст и искать запрещенные высказывания.

Но определённые виды контента, например, текстовые сообщения или комментарии, требуют более глубокого анализа. Здесь важно понимать контекст и распознавать завуалированную токсичность или манипулятивные элементы.

Оптимальным решением становится комбинированный подход, при котором автоматизированные системы выполняют первичную обработку контента, а спорные и неоднозначные случаи передаются на проверку модераторам.

При таком подходе ответы модераторов могут помочь обучению моделей, чтобы учитывать различные способы обхода фильтров. Например, завуалированные ругательства могут распознаваться только после тонкой настройки алгоритмов. А для более сложных случаев, где важен контекст, человек остаётся незаменим.

| Плюсы комбинированной модерации | Минусы комбинированной модерации |

|---|---|

| Высокая эффективность и точность Автоматические системы обрабатывают большой поток данных, а спорные или сложные кейсы передаются людям, что минимизирует ошибки. | Затраты на внедрение и поддержку Создание и обучение автоматической системы требует значительных инвестиций, а также затрат на её регулярное обновление. Чтобы дообучить систему для распознавания новой терминологии или мемов, могут потребоваться недели работы специалистов. |

| Экономия ресурсов Основная часть работы автоматизируется, что снижает затраты на ручную модерацию. Люди подключаются только там, где требуется их компетенция. | Риски несогласованности В некоторых случаях результаты работы людей и ИИ могут различаться, что приводит к конфликтам в решениях и жалобам пользователей. |

| Обеспечение контекстуальной справедливости Люди могут рассматривать сложные случаи, связанные с тонкостями языка, контекста или культурных особенностей, которые не всегда распознаются алгоритмами. Например, в ситуации, где одно и то же слово может быть оскорблением или безобидным комментарием, только модератор способен оценить контекст. | Зависимость от человеческого фактора Люди, несмотря на опыт, подвержены усталости, субъективности и ошибкам. Особенно при высоких объёмах работы. |

| Гибкость и масштабируемость Модели ИИ можно дообучать по мере роста объема контента, а ручная модерация обеспечивает адаптацию к новым видам угроз или обходным маневрам нарушителей. | Проблемы с временной задержкой Хотя автоматическая модерация работает мгновенно, ручная проверка может занять время, особенно если объем спорных кейсов велик. |

| Снижение нагрузки на модераторов Люди работают с уже отфильтрованным контентом, не тратя время на обработку очевидных нарушений или спама. |

Как это может применяться на практике?

Приведем пример удачного применения гибридной модерации из нашего опыта. Один из крупнейших маркетплейсов в СНГ обратился к нам с амбициозной целью: найти и удалить контактную информацию с изображений, чтобы повысить безопасность пользователей. Вот как это получилось на практике.

Заказчик поставил перед нами конкретные задачи:

- Распознавать номера телефонов, e‑mail и ссылки, даже если они замаскированы или представлены в необычном формате.

- Сократить время обработки — полный цикл модерации не должен занимать больше часа.

- Минимизировать ошибки, чтобы избежать блокировки корректных объявлений.

Решение: от анализа до масштабирования

Наш подход можно описать так:

Этап 1: Разбор задачи и обучение команды

Мы начали с глубокого анализа. На изображениях контактная информация порой прячется в неожиданных местах — под углом, в нечетком тексте или даже на нескольких языках. Команда разработала чёткие критерии для разметки и подготовила обучающие материалы с примерами. Каждый аннотатор изучал как простые случаи, так и сложные кейсы, такие как контакты, спрятанные в рекламе или визуально сливающиеся с фоном.

Этап 2: Построение инфраструктуры

На старте мы собрали команду модераторов, которые вручную размечали данные. Чтобы справляться с пиковыми нагрузками, была создана резервная группа специалистов, готовая подключиться в любой момент. Это позволило нам обрабатывать до 20 тысяч задач в час, даже при резком увеличении объёмов.

Этап 3: Контроль качества

Мы внедрили двухуровневую систему проверки. Сначала модераторы оценивали разметку, устраняя возможные ошибки. Затем финальная проверка фильтровала мельчайшие неточности. Такая система гарантировала, что на этапе автоматической обработки алгоритм получает только качественные данные.

Вызовы: от пиковых нагрузок до “хитрых” пользователей

Работа над проектом не обошлась без сложностей:

- Нестандартные кейсы: Пользователи изобретательно скрывали контакты, например, разрывая цифры на части или комбинируя символы разных языков. Мы обновили инструкции для аннотаторов, чтобы справляться с такими случаями.

- Пики нагрузки: При резких всплесках новых объявлений (до 740 тысяч изображений в месяц) мы внедрили автоматическое распределение задач и приоритизацию, сохраняя высокую скорость обработки.

- Точность модели: Регулярное переобучение позволило нам адаптироваться к новым типам изображений и снижать вероятность ошибок.

Результаты: точнее, быстрее, надёжнее

Через несколько месяцев работы проект стал полноценным примером того, как технология может трансформировать процессы:

- Точность автоматической модерации выросла на 20%. Это позволило снизить количество задач, отправляемых на ручную проверку, на ~14%.

- Скорость обработки объявлений удерживалась в пределах часа даже при максимальной нагрузке.

- Клиент передал нам весь объём ручной модерации. Доверие партнёра говорит само за себя.

Сегодня этот проект продолжает развиваться, а наш подход помогает маркетплейсу оставаться безопасным и комфортным местом для миллионов пользователей.

Почему компании выбирают аутсорсинг модерации?

Многие компании, как и наш клиент, также предпочитают передавать модерацию на аутсорсинг. Это позволяет:

- Снизить затраты. Внутренние ресурсы освобождаются для решения других задач.

- Повысить оперативность. Контент проверяется быстрее, улучшая пользовательский опыт.

- Обеспечить стабильность. Внешние специалисты следуют единым стандартам проверки, что повышает её качество.

Мы предоставляем услуги модерации под ключ: от настройки процессов до обучения модераторов и контроля качества, мы обеспечиваем высокий уровень подготовки команды, включая систему наставничества и KPI. Это даёт клиентам уверенность в том, что их платформа защищена от нежелательного контента, а пользователи получают только качественный опыт взаимодействия.